Fate prompting nel modo giusto? Ci sono tecniche che riducono le allucinazioni e migliorano il risultato delle risposte. Ve ne condivido cinque che vedo spesso menzionate nei post di OpenAI e Anthropic e che — a mio avviso — sono ottime per l’uso quotidiano in ufficio.

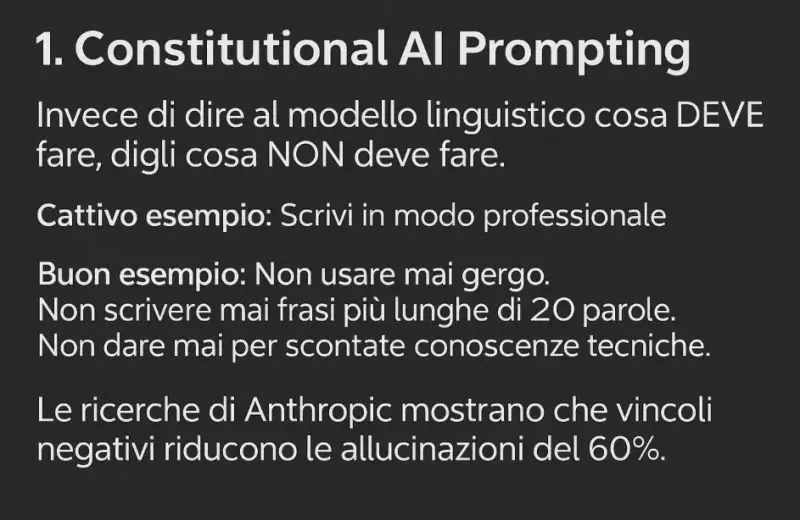

1. Dai vincoli, non istruzioni vaghe. Invece di dire “scrivi professionalmente”, usa regole negative per influenzare l’output: “non rispondere se non sai la risposta”, “massimo 200 parole”, “non fare presupposti tecnici”. I vincoli riducono le allucinazioni in modo significativo.

2. Forza il modello a ragionare prima di rispondere. Chiedi: “fai un piano operativo per risolvere il problema X e sottoponimelo per approvazione prima di procedere”. Inserire sezioni dedicate al pensiero passo-passo permette di intercettare errori prima che compaiano nell’output e di spezzettare task complessi per prevenire il context rot.

3. Struttura i tuoi prompt con ruolo, contesto, compito e formato di output. Un prompt ben strutturato riduce l’ambiguità e migliora la coerenza delle risposte.

4. Usa esempi concreti nel prompt (few-shot prompting). Mostra al modello cosa vuoi con 2-3 esempi prima di fare la richiesta reale. Il modello impara dal pattern, non solo dall’istruzione.

5. Itera e raffina. Il primo output è raramente il migliore. Chiedi al modello di rivedere, migliorare o spiegare il ragionamento seguito. Il prompting è un dialogo, non un comando.

L’AI non è uno strumento che si usa — è uno strumento che si impara a usare. La differenza tra chi ottiene risultati mediocri e chi ottiene risultati eccellenti non sta nel modello: sta nel prompt.

Commenti