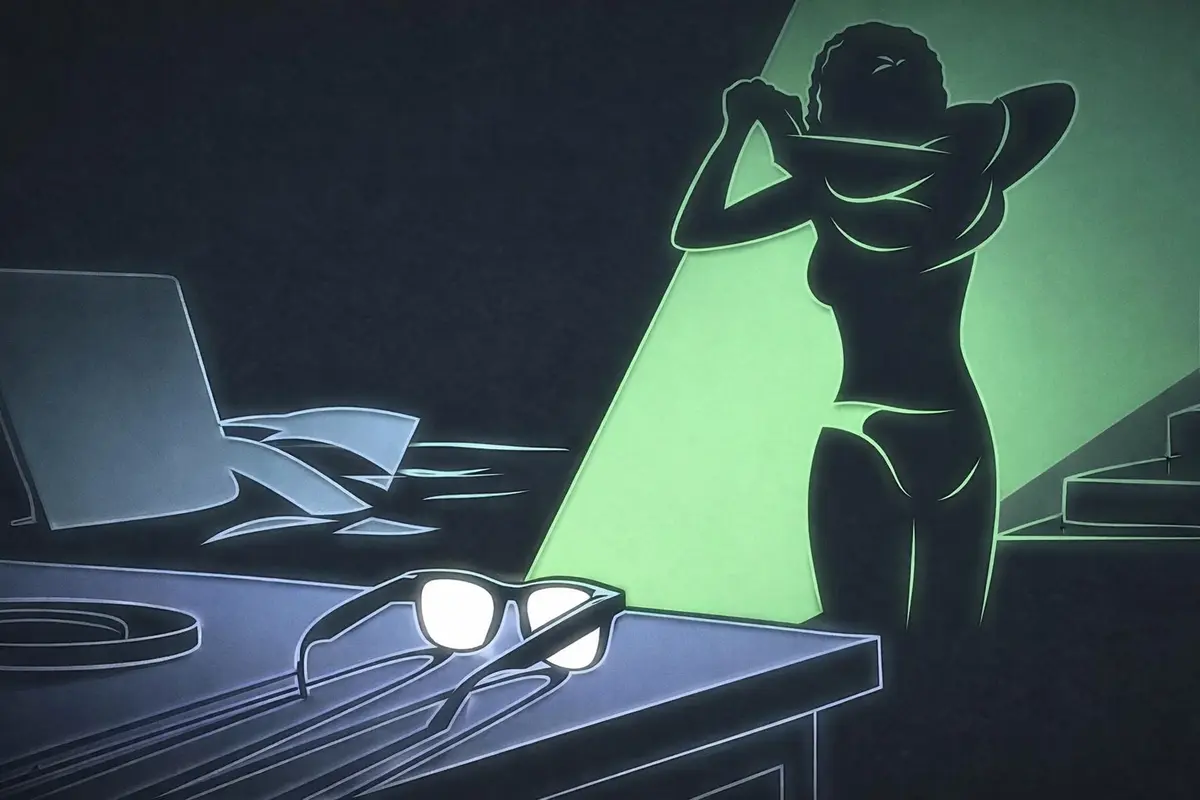

Vi ricordate il film Anon, oppure quell’episodio inquietante di Black Mirror dove tramite impianti oculari si vede tutto della vita e dal punto di vista degli occhi di un altro? Beh, mi tocca ricordarvi che non è fantascienza e che la realtà è ancora più oscura dei film.

Secondo un’inchiesta di Svenska Dagbladet (bellissimo long format, andatevelo a leggere nel link al primo commento n.d.r.) le nuove AI smart glasses di Meta non sono soltanto occhiali futuristici, ma dispositivi che catturano audio e video sensibili - per lo piu senza piena consapevolezza dell’utente - e li inviano a annotatori umani in paesi come il Kenya per addestrare l’Iintelligenza Artificiale.

Leggendo l’articolo scoprirete come le immagini registrate (anche intime o private) finiscono nei database di Meta e vengono analizzate da lavoratori esterni per etichettarle.

E se vi state chiedendo dove sia finito il diritto alla privacy, sappiate che ‘guardone’ Zuckemberg si pulisce il cul8 con l’idea che questi diritti siano messi in crisi dal fatto che altre persone - lontane migliaia di chilometri - guardano ciò che ‘dovrebbe essere privato’. Tutto sull’altare di un miglioramento al prossimo motore di AI.

Al netto dei lustrini, l’adesione al servizio è obbligatoria, i termini di servizio sono vaghi e mutevoli al primo raffreddore di Mark e ovviamente v’è trasparenza limitata e ampi spazi di ambiguità su chi vede cosa e per quanto tempo.

Non posso che rilevare quanto la tecnologia avanzi a una velocità che sembra appartenere ad un altro universo rispetto alle nostre regole sociali e culturali.

Da una parte abbiamo strumenti che potenzierebbero la realtà o oppure le nostre capacità operative e creative grazie all’AI; dall’altra, c’è un bisogno fondamentale di spazio personale, controllo, autonomia e privacy.

Ma davvero pensiamo che quando usiamo occhiali AR, assistenti vocali o modelli LLM, non ci sia qualcuno - magari un annotatore in Kenya o altrove - che guarda e interpreta dati che dovrebbero essere solo nostri?

Crediamo davvero che tutti i livelli di inferenza automatica siano ‘solo macchina’ e non ‘macchina + occhi umani a moderazione e controllo’ , magari in paesi diversi con regole differenti dalle nostre?

Mi chiedo se Antonino Polimeni abbia voglia di leggere questo articolo e dirci cosa ne pensa lato normativo.

E a voi lancio un challenge: pensate che queste nuove tecnologie stiano servendo davvero le persone, o stiano invece lentamento cancellando il nostro spazio personale e le nostre capacità critiche sull’altare del profitto di pochi imperialisti statunitensi?

Commenti